Im Zentrum steht Alpamayo‑R1 (AR1), eine offene VLA‑Modellfamilie (Vision–Language–Action), die Wahrnehmung, Sprachverständnis und Handlungsplanung in einem System verbindet. AR1 analysiert Szenen Schritt für Schritt, simuliert mögliche Bewegungen, gewichtet Risiken und wählt anschließend die sicherste und sinnvollste Handlung – etwa in chaotischen Verkehrssituationen mit Fußgängern, Autos und unerwarteten Hindernissen.

Die Modelle laufen auf der Plattform Nvidia Cosmos Reason und stehen Forschenden offen zur nichtkommerziellen Nutzung bereit, inklusive Code auf GitHub und Hugging Face sowie Trainingsdaten in den „Nvidia Physical AI Open Datasets“. Über das Simulations-Framework AlpaSim lassen sich komplexe Szenarien virtuell testen, bevor echte Roboter oder Fahrzeuge ins Spiel kommen.

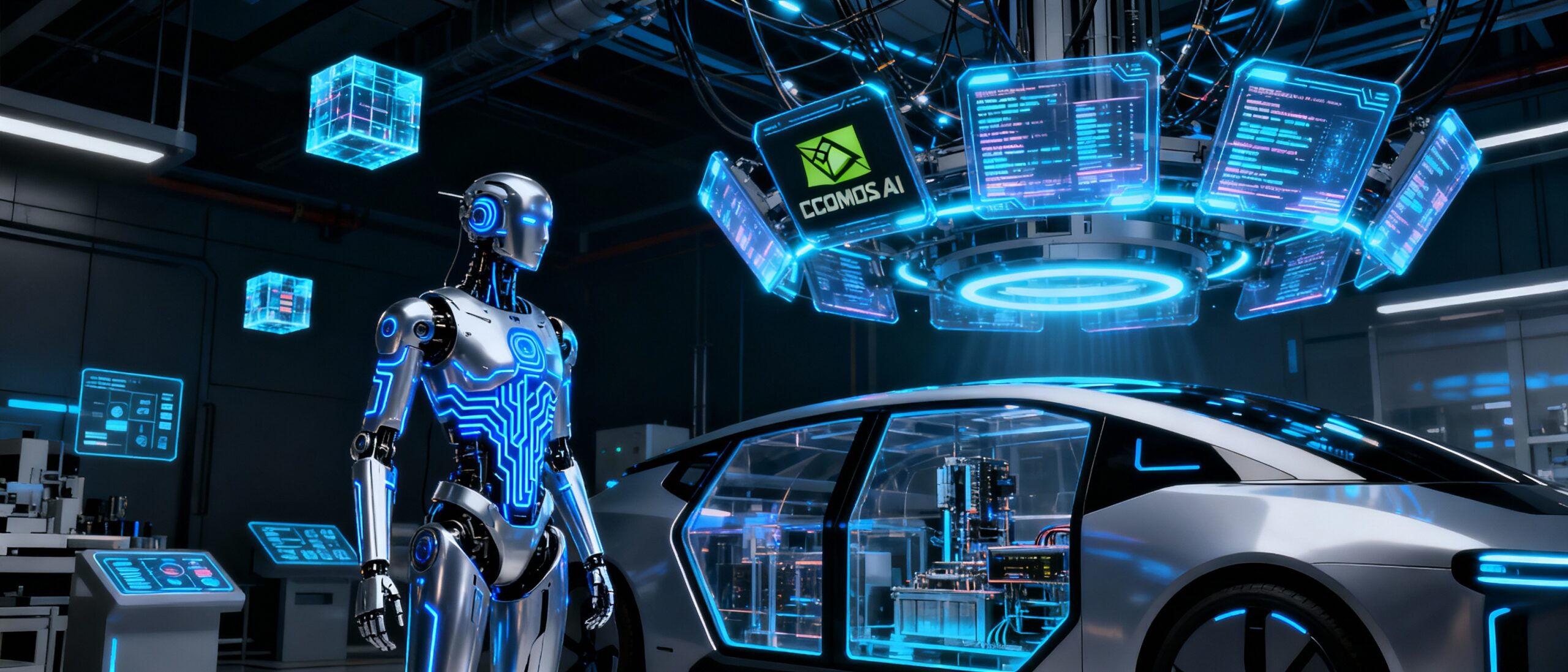

Cosmos-Ökosystem: Vom Lidar bis zum Humanoiden

AR1 ist nur die Spitze eines größeren „Cosmos“-Stacks für physische Systeme.

- LidarGen erzeugt synthetische Lidar-Daten für das Training von autonomen Fahrzeugen.

- Omniverse NuRec Fixer bereinigt neuronale 3D‑Rekonstruktionen von Szenen.

- Cosmos Policy hilft beim Ableiten von Verhaltensregeln für Roboter.

- ProtoMotions3 trainiert humanoide Roboter in realistischen virtuellen Umgebungen – vom Lager bis zur Straße.

Unternehmen wie Voxel51, 1X, Figure AI, Foretellix, Gatik, Oxa, PlusAI und X‑Humanoid testen diese Bausteine bereits in eigenen Projekten, ebenso Forschungsgruppen wie jene der ETH Zürich.

Nemotron & Audio Flamingo 3: Offene KI für Sprache und Sound

Parallel stärkt Nvidia seine offenen Modelle für digitale Anwendungen. Die Nemotron‑Reihe bekam mehrere Upgrades:

- MultiTalker Parakeet erkennt mehrere Sprecher gleichzeitig.

- Sortformer trennt Stimmen in Echtzeit.

- Neue synthetische Datensätze verbessern Reasoning und Domänen‑LLMs.

Mit Audio Flamingo 3 bringt Nvidia zudem eine große Audiomodell‑Familie, die Sprache, Musik und Geräusche in einer gemeinsamen Logik analysiert. Minitron‑SSM wiederum komprimiert hybride Modelle spürbar, ohne die Genauigkeit drastisch zu verschlechtern – wichtig für Edge‑Einsätze.

Beschleuniger für LLMs: Jet-Nemotron, Nemotron-Flash und ProRL

Um große Sprachmodelle im Betrieb schneller und günstiger zu machen, stellte Nvidia Jet‑Nemotron und Nemotron‑Flash vor – speziell optimierte Pipelines für Inferenz mit niedriger Latenz. Die firmeneigene ProRL‑Methodik (Prolonged Reinforcement Learning) soll LLMs und VLA‑Modelle beim logischen Denken systematisch verbessern und sie gegenüber Basisvarianten robust überlegen machen.

Nach Einschätzung der Analysefirma Artificial Analysis zählt Nemotron aktuell zu den offensten und am besten dokumentierten Modellfamilien im Markt – ein Pluspunkt für unabhängige Forschung und spezialisierte Unternehmens‑Use‑Cases.

Bedeutung für Forschung, Start-ups und Industrie

Für Hochschulen und unabhängige Labs bedeuten AR1, Cosmos und Nemotron vor allem eins: weniger Hürden zwischen Idee und Prototyp, weil zentrale Bausteine frei verfügbar sind. Start-ups in Robotik, Logistik, Mobility oder Audio können auf ausgereifte Komponenten zurückgreifen, statt alles selbst zu entwickeln – und ihre Ressourcen auf Differenzierung und Produktreife fokussieren.

Für die Industrie entsteht ein Ökosystem, in dem physische und digitale KI enger zusammenwachsen: vom Sensor (Lidar, Kamera, Mikrofon) über Simulation und Training bis hin zur Inferenz auf realer Hardware. Wer in den kommenden Jahren autonome Maschinen in die Fläche bringen will, wird an Nvidias „Physical + Digital AI“-Stack kaum vorbeikommen.